Economía y Finanzas del comportamiento

Uno de los supuestos que sostiene la ley de la oferta y la demanda es que cuando aumenta el precio de un bien, la demanda o el consumo de éste baja; asimismo, cuando disminuye el precio, incrementa el consumo. Pero esto no es del todo cierto, pues muchas veces las personas creen que cuando un producto es caro, significa que es bueno, o si es barato, piensan que su calidad es mala.

La suposición sobre la veracidad de la ley de la oferta y la demanda se debe a que la economía tradicional asume que los consumidores tienen información perfecta sobre los precios y sobre la calidad de los productos, pues da por hecho que dicha información se adquiere fácilmente. De la misma manera, asume que las personas tienden a buscar la manera de obtener el mayor rendimiento empleando una mínima cantidad de recursos o reduciendo los costos que se puedan considerar innecesarios. A esto se le conoce como optimización.

No obstante, empíricamente se ha observado que cuando los consumidores toman una decisión no actúan siempre de manera racional, pues tienen limitaciones cognitivas o simplemente no tienen la información suficiente o el tiempo necesario para escoger la mejor opción.

Este hecho ha representado un problema para la economía contemporánea, pues algunos modelos económicos, valga la redundancia, se han desarrollado con base en la creencia de que las personas son racionales y predecibles.

Sin embargo, la economía es una ciencia social que estudia los procedimientos productivos y de intercambio, así como analiza el consumo de bienes y servicios. En otras palabras, gran parte de su campo de estudio se dirige a las acciones humanas, lo que aparentemente se ha ignorado por mucho tiempo.

En 1759, el filósofo moral y reconocido padre de la economía, Adam Smith, escribió la obra Teoría de los sentimientos morales, la cual se enfoca en el efecto que tienen las pasiones –sentimientos y motivaciones– sobre las decisiones económicas, pues para él era evidente este hecho y su importancia.

Así, la economía y las finanzas del comportamiento retoman la perspectiva de Adam Smith con el fin de mejorar y modificar la teoría económica predominante.

Economía neoclásica

La económica neoclásica es la tendencia dominante desde mediados del siglo XX hasta la actualidad. Ésta se formó en la década de 1870 en Reino Unido, Austria y Suiza. Sus fundadores, William Stanley Jevons, Alfred Marshall y Leon Walras, entre otros, apoyaron el análisis matemático de los procesos económicos y el uso de la teoría o ley de la utilidad marginal, la cual establece que el aumento en el consumo de un bien produce menor utilidad adicional, pues se genera una valoración decreciente del bien.

Los logros contemporáneos de la economía neoclásica, considerada la corriente económica principal, se usan en microeconomía para estudiar el equilibrio del mercado. Para explicar el comportamiento del ser humano económico, el enfoque neoclásico hacia el consumidor se basa en un conjunto de axiomas, los cuales no se pueden demostrar empíricamente y asumen que las descripciones del consumidor y del mercado son suficientemente realistas. Dos de estos axiomas son:

- La racionalidad de las decisiones del consumidor, es decir, elecciones que maximizan la utilidad:

La racionalidad determina cada elección independientemente de su importancia objetiva para el bienestar del consumidor o su carga financiera. Las decisiones particularmente importantes son la elección entre el ocio y el trabajo, las cuales afectan el ingreso; la distribución del ingreso entre el consumo y los ahorros, definiendo los niveles de consumo futuros y actuales; y la elección de una canasta de bienes en específico, la mejor en términos de preferencia y restricciones.

El postulado de la racionalidad expresado como el principio de maximización de las acciones (optimización, es decir, la acción de hacer uso efectivo de los recursos y la práctica más eficaz en función de los costos para obtener el mejor rendimiento) significa que al ser humano económico se le atribuye la característica de hiperracionalidad, esto es, el conocimiento completo y verdadero y la capacidad de procesarlo de tal manera que saque conclusiones lógicas sobre las elecciones que hace.

- Conocimiento sobre los productos e información completa de las condiciones de transacción:

Se asume que el consumidor sabe o es capaz de saber todas las posibilidades del mercado, junto con la variedad de precios y los usos específicos de bienes individuales. El acceso a la información no requiere mucho tiempo, esfuerzo mental u otros recursos escasos que compliquen la toma de decisión. La economía neoclásica asume que la gente es sumamente inteligente y que las situaciones son muy simples.

La teoría neoclásica de la elección del consumidor excluye del ser humano imperfecciones, emociones, intereses y el bagaje social sobre la economía. Como resultado, el principio de maximización junto con el concepto de equilibro como estado deseado por las entidades, los mercados y la economía, significa que la economía neoclásica está limitada a un análisis formalizado y estático.

Este enfoque proviene de la creencia sobre que la racionalidad es un concepto que no requiere definición y que ser considerado como tal significa ser juzgado como razonable, apropiado y con un objetivo reconocido. Esta suposición parece justificarse en la medida en que la capacidad de razonar se suele asumir para distinguir a los seres humanos de los animales. Sin embargo, no existe un consenso en cuanto a la naturaleza de dicha capacidad.

Así, esta teoría económica se basa en el concepto del homo oeconomicus, el cual asume la racionalidad en el comportamiento del consumidor y se refiere al consumidor individual en vez de a un grupo o una comunidad. Se fundamenta en tres suposiciones que muestran que el consumidor: tiene necesidades específicas y las puede definir, puede priorizar sus necesidades, toma elecciones que satisfacen sus necesidades al máximo.

Entonces, la teoría neoclásica de la elección del consumidor se basa en el concepto de utilidad esperada y es normativa, pues asume que actuar de acuerdo con el criterio de racionalidad debe conformar las siguientes reglas:

- Integridad o consistencia de preferencias, es decir, que al hacer una elección entre diferentes combinaciones de bienes, el consumidor es capaz de especificar sus preferencias en relación con estos.

- Reflexividad de preferencias, es decir, que dos canastas de bienes idénticas no se distinguen dentro de las preferencias individuales del consumidor.

- Transitividad de preferencias, es decir, que si el consumidor tiene preferencia por bienes x sobre bienes y, y por bienes y sobre bienes z, entonces esto implica preferencia por x sobre z.

- Insaciabilidad de preferencias, es decir, que el consumidor siempre prefiere más en vez de menos, por lo tanto, prefiere combinaciones de bienes que provean más satisfacción a combinaciones que aseguren menos.

Dichas reglas, por un lado, dan por hecho que los consumidores hacen elecciones que maximizan su utilidad y, por otro lado, forman la base para determinar reglas normativas de comportamiento.

No obstante, el rechazo de la economía neoclásica hacia el factor social ha resultado en una gran limitación para ésta, pues no ha sido capaz de explicar ciertos fenómenos. Por ello, algunos economistas opinan que el modelo básico de la economía neoclásica no representa una economía humana, pues asume que las personas son sumamente racionales y resistentes a las emociones.

La mayoría de los economistas aceptan las suposiciones principales de esta corriente económica, a saber, que la economía se puede describir a través de leyes, que consiste en entidades independientes, que no favorece a ningún género, que los riesgos económicos se pueden manejar con base en estadísticas, que es estable, racional y eficiente.

Por lo dicho, el análisis crítico hacía la economía neoclásica sugiere que los cambios se deben dirigir a:

- Rechazar la creencia sobre la racionalidad de los individuos y sobre la información perfecta. Los consumidores no siempre tienen la información necesaria sobre los productos y muchas veces no comportan de manera racional cuando van a tomar una decisión sobre la compra de algún bien;

- Tomar en cuenta los factores psicológicos para analizar el comportamiento de los individuos, de tal manera que las suposiciones sean más realistas. El comportamiento de los consumidores depende, entre otras cosas, de necesidades innatas y adquiridas, procesos conscientes e inconscientes y de factores racionales y emocionales;

- Abandonar el enfoque puramente matemático en la investigación económica y considerar los avances de otras ciencias sociales (psicología, sociología, neurobiología, etc.), así el factor social será incluido en el análisis económico y aumentará la importancia de los análisis cuantitativos;

- Extender el periodo de investigación.

En resumen, el modelo del comportamiento racional (homo oeconomicus) le da independencia aparente a la economía al describir y explicar los fenómenos y los procesos económicos, por lo que se necesita modificar el modelo de análisis de esta ciencia.

Economía del comportamiento

La economía del comportamiento trata de vincular los conocimientos de la economía, psicología, sociología y neurobiología, con el fin de explicar el comportamiento y los fenómenos que no comprende la economía neoclásica.

Como se había mencionado, el criterio de los modelos dominantes encuentra su fundamento en tres suposiciones poco realistas, a saber: racionalidad ilimitada, fuerza de voluntad ilimitada y egoísmo ilimitado. Así pues, la economía del comportamiento ha tratado de mejorar dicha teoría refutando estas suposiciones.

El programa de investigación de la economía del comportamiento se compone de dos elementos, estos son: la identificación de los casos en los que el comportamiento difiere de aquellos que asume la economía neoclásica, y la exposición del papel que juegan dichos comportamientos en la economía. En otras palabras, el fin de la economía del comportamiento es que las teorías económicas sean más útiles al mejorar su capacidad para explicar y predecir el comportamiento de los individuos con suposiciones más realistas que tomen en cuenta el factor social.

Las raíces de la economía del comportamiento se encuentran en la corriente psicológica conocida como conductismo, la cual se desarrolló en la década de 1930. El término “economía del comportamiento” se usó por primera vez en 1958, no obstante, su emergencia tajante fue en 1979, cuando Daniel Kahneman y Amos Tversky publicaron su famoso artículo “Prospect Theory: An Analysis of Decisions under Risk” en Econometrica, una prestigiosa revista de economía. Bajo este nuevo contexto la economía aprende de, se construye con base en, coopera con, y cede a otras disciplinas.

Dentro de la economía del comportamiento existen dos tendencias principales que prácticamente representan disciplinas independientes entre sí. La primera tendencia de investigación ha combinado las metodologías de la investigación psicológica con los recursos del conocimiento teórico de la economía para examinar el comportamiento. La segunda tendencia se ha enfocado en los logros de investigadores como Kahneman, Tversky, y Richard Thaler, quienes han hecho un exhausto análisis sobre las desviaciones del ser humano en relación con el comportamiento racional.

Así pues, la economía del comportamiento se concentra en los resultados experimentales que indican irregularidades y desviaciones de la teoría neoclásica. Además, al enfocarse en los sesgos y los errores que surgen en la toma de decisiones, vuelca el análisis del comportamiento hacía la psicología. Así, este nuevo enfoque trata de brindar una respuesta a las lagunas que deja la economía neoclásica.

Las suposiciones que engloba la economía del comportamiento se vinculan con tres elementos comunes, a saber:

- Cuestionar la suposición sobre la racionalidad en las acciones humanas, es decir, trata de alejarse del modelo del homo oeconomicus;

- Recurrir a la psicología con el fin de explicar la complejidad del comportamiento humano, especialmente en momentos de crisis, incertidumbre, falta de claridad y dificultad;

- Refutar la teoría económica dominante examinando las anomalías y alejándose de los modelos económicos simplificados.

En resumen, el área de interés de la economía del comportamiento es el análisis de los motivos y principios de la acción humana en situaciones complejas e inciertas, las cuales muchas veces prevalecen en los mercados actuales.

Uno de los desarrollos más importantes de este nuevo enfoque es la Teoría Prospectiva de Kahneman y Tversky, en la cual aseveran que las decisiones de los individuos están influenciadas por las emociones, actitudes, percepciones y contextos de simulación. Desde su punto de vista las elecciones de los individuos están guiadas por heurísticas, las cuales funcionan bien en condiciones normales, no obstante, pueden dar cabida a errores.

Heurísticas y sesgos cognitivos

Tversky, filósofo y psicólogo matemático, descubrió fallas en los cimientos de la racionalidad y junto con Kahneman desarrolló una teoría descriptiva sobre la toma de decisiones del consumidor, la cual contrasta fuertemente con la teoría normativa de la economía neoclásica.

Sus descubrimientos fueron publicados en dos artículos, a saber: “Judgement under uncertainty: Heuristics and Biases” en la revista de investigación científica Science, en 1974; y “Prospect Theory: An Analysis of Decisions under Risk” en la prestigiosa revista de economía Econometrica, en 1979, donde presentaron la Teoría Prospectiva.

En el primer artículo –1974– Tversky y Kahneman aseveraron que los seres humanos tomamos muchas decisiones sobre la probabilidad de eventos inciertos con base en creencias, como el resultado de una elección, la culpabilidad de un acusado o el valor futuro del dólar.

La teoría sostiene que nos basamos en un número limitado de heurísticas al evaluar la probabilidad de eventos inciertos o el valor de cantidades desconocidas, pues reducen la complejidad de la evaluación de probabilidades y de la predicción de valores a operaciones de juicio más simples. Por lo general estas heurísticas son muy útiles, no obstante, pueden resultar en severos errores sistemáticos.

La evaluación subjetiva de probabilidades es parecida a la evaluación subjetiva de cantidades físicas, como el tamaño o la distancia. Estos juicios se hacen con base en información de validez limitada que se procesa de acuerdo con reglas heurísticas. Por ejemplo, la distancia aparente de un objeto se determina en parte por su claridad. Si el objeto es visto con definición, parece que es más cercano. Esta regla tiene alguna validez, pues en cualquier escenario si los objetos se encuentran distantes son vistos con menos definición que los objetos cercanos. Específicamente las distancias se sobrestiman cuando la visibilidad es pobre debido a que el contorno de los objetos es borroso, y se subestiman cuando la visibilidad es buena debido a que los objetos son vistos con definición.

En consecuencia, la confianza en la claridad como indicador de una distancia lleva a sesgos cognitivos comunes. Dichos sesgos también se encuentran en el juicio intuitivo de probabilidades.

Tversky y Kahneman describieron tres heurísticas que emplean las personas para evaluar probabilidades y predecir valores, a saber, la heurística de la representatividad, la de disponibilidad y la de ajuste y anclaje; asimismo, describieron los sesgos cognitivos a los que llevan estos atajos mentales.

a) Heurística de la representatividad

La heurística de la representatividad captura la idea de que las probabilidades son evaluadas por el grado en el que un evento u objeto son representativos de una clase de eventos u objetos. En otras palabras, las probabilidades se evalúan por el grado en el que A es representativo de B, esto es, el grado en el A se parece a B. Por ejemplo, cuando A es muy representativo de B, la probabilidad de que A sea consecuencia de B se juzga alta; pero si A no es similar a B, la probabilidad de que A sea consecuencia B se juzga baja.

Para que se entienda, a un grupo de personas se les describe un individuo de la siguiente manera: “Pedro es un tipo muy tímido y retraído, siempre servicial, pero con poco interés por las personas y por el mundo de la realidad. De alma limpia y dócil, siempre tiene necesidad de orden y estructura, y pasión por el detalle.”

Posteriormente al grupo de personas se les da una lista de las posibles ocupaciones de Pedro para que evalúen cuál es la más probable, por ejemplo, agricultor, vendedor, piloto de aviones, bibliotecario o médico. En la heurística de la representatividad la probabilidad de que Pedro sea un bibliotecario se evalúa alta por el grado en el que éste es representativo de, o similar a, el estereotipo de un bibliotecario.

Los estudios de este tipo de problemas han mostrado que las personas ordenan las ocupaciones con base en la probabilidad y la semejanza, exactamente como se muestra en el ejemplo.

Este enfoque del juicio de probabilidad lleva a cometer graves errores debido a que la semejanza o la representatividad no se ven influenciadas por otros factores importantes que deberían afectar este tipo de juicios.

Algunos sesgos cognitivos de este tipo de heurística son:

- Insensibilidad a la probabilidad previa de resultados

Uno de los factores que no tiene efecto en la representatividad, no obstante, debería tener un mayor efecto en la probabilidad, es la probabilidad previa o la tasa básica de frecuencia de los resultados. En el caso de Pedro, por ejemplo, el hecho de que en la población haya más agricultores que bibliotecarios debería entrar en cualquier estimación razonable de la probabilidad de que Pedro sea un bibliotecario en vez de un agricultor. Sin embargo, las consideraciones de la tasa básica de frecuencia no afectan la semejanza de Pedro con los estereotipos de bibliotecarios y agricultores. Por lo tanto, si las personas evalúan la probabilidad con base en la representatividad, entonces, las probabilidades previas serán ignoradas.

Esta hipótesis se examinó en un experimento en donde las probabilidades previas fueron manipuladas. A un grupo de personas se le describió ciertas características de personalidad de varios individuos, supuestamente tomadas al azar de un grupo de 100 profesionistas –ingenieros y abogados. A dicho grupo se le pidió que evaluara, para cada descripción, la probabilidad de que perteneciera a un ingeniero o a un abogado. En una condición experimental, se le dijo al grupo que la descripción se había tomado de un conjunto de profesionistas que consistía de 70 ingenieros y 30 abogados. En la otra condición experimental, se le dijo al grupo que el conjunto consistía de 30 ingenieros y 70 abogados. En la primera condición las probabilidades de que cualquier descripción perteneciera a un ingeniero en vez de a un abogado deberían ser más altas; asimismo, en la segunda condición las probabilidades de que cualquier descripción perteneciera a un abogado en vez de a un ingeniero deberían ser más altas.

Sin embargo, los grupos en ambas condiciones experimentales hicieron básicamente los mismos juicios de probabilidad. Aparentemente los grupos evaluaron la probabilidad de que una descripción particular perteneciera a un ingeniero en vez de a un abogado por el grado en el que la descripción era representativa de ambos estereotipos, sin tomar en cuenta la probabilidad previa o tasa básica de frecuencia de las categorías.

Los grupos usaron las probabilidades previas correctamente cuando no se les dio otro tipo de información, es decir, sin una descripción de personalidad.

- Insensibilidad al tamaño de la muestra

Para evaluar la probabilidad de un resultado particular de una muestra tomada de una población, las personas por lo general emplean la heurística de la representatividad. Es decir, evalúan la probabilidad del resultado de una muestra, por ejemplo, que la estatura promedio en una muestra al azar de 10 hombres será 1.80 metros, con base en la semejanza de este resultado con el parámetro correspondiente (esto es, la estatura promedio de la población de hombres). En este caso, la semejanza de la estadística de una muestra con el parámetro de la población no depende del tamaño de la muestra. En consecuencia, si las probabilidades se evalúan con base en la representatividad, entonces la probabilidad juzgada de una muestra será independiente del tamaño de la muestra.

En otras palabras, cuando las personas evalúan las distribuciones de una estatura promedio en varias muestras de diferente tamaño, realizan distribuciones idénticas. Por ejemplo, a la probabilidad de obtener una estatura promedio más alta de 1.80 metros se le asignó el mismo valor para muestras de 1000, 100 y 10 hombres. En otras palabras, las personas no lograron apreciar el papel del tamaño de la muestra aun cuando éste se enfatizó en la formulación del problema. Tómese en cuenta el siguiente caso:

Un pueblo es atendido por dos hospitales. En el hospital más grande nacen cerca de 45 bebés al día; en el hospital pequeño, aproximadamente 15. Alrededor del 50 por ciento de los bebés son hombres. No obstante, el porcentaje exacto varía día con día. A veces rebasa el 50 por ciento, a veces es menor.

Durante un año cada hospital registró los días en los que más del 60 por ciento de los bebés fueron hombres ¿Qué hospital crees que registró más días?

- El hospital grande (21)

- El hospital pequeño (21)

- Aproximadamente lo mismo (53)

Los valores en paréntesis son el número de estudiantes de licenciatura que escogieron cada respuesta.

Como es evidente, la mayoría de los estudiantes juzgaron que la probabilidad de obtener más del 60 por ciento de bebés hombres durante un número de días en el lapso de un año era la misma en el hospital pequeño y en el grande, posiblemente debido a que estos eventos se describen bajo las mismas estadísticas y, por lo tanto, son igualmente representativos de la población general. En contraste, la teoría del muestreo sostiene que el número de días en los cuales más del 60 por ciento de los bebés fueron hombres es mucho mayor en el hospital pequeño que en el grande, pues una muestra amplia tiene menos probabilidad de desviarse del 50 por ciento. Esta noción fundamental de estadística parece no ser parte del repertorio intuitivo de las personas.

- Concepción errónea del azar

Las personas creen que una secuencia de eventos generados por un proceso al azar representa las características esenciales de ese proceso aun cuando dicha secuencia es corta. Por ejemplo, consideran que la secuencia H-T-H-T-T-H es más común que la secuencia H-H-H-T-T-T, que no parece aleatoria; asimismo, la consideran más común que la secuencia H-H-H-H-T-H, que no parece representar la equidad de una moneda, por así decirlo.

En otras palabras, las personas creen que las características esenciales del proceso serán representadas, no solo globalmente en la secuencia entera, sino también localmente en cada una de sus partes. No obstante, una secuencia local representativa se desvía sistemáticamente de la expectativa azarosa, pues contiene muchas alternancias y pocas corridas.

Otra consecuencia de la creencia en la representatividad local es la conocida falacia del jugador o falacia de Montecarlo. Por ejemplo, después de observar que en un juego de ruleta la bola cae repetitivamente en el color rojo, la mayoría de las personas cree erróneamente que la bola posteriormente debe caer en color negro, supuestamente porque la ocurrencia del negro resultará en una secuencia más representativa que si la bola vuelve a caer en el color rojo.

El azar comúnmente es visto como un proceso que se corrige a sí mismo, es decir, una desviación hacia un camino induce una desviación hacia el camino contrario, pues se debe restaurar el equilibrio. Sin embargo, lo cierto es que las desviaciones no se “corrigen” cuando el proceso aleatorio se desarrolla, sino que simplemente se diluyen.

- Insensibilidad a la predictibilidad

Las predicciones numéricas, como el valor futuro de una acción financiera, la demanda de algún producto o el resultado de un partido de fútbol, a veces se hacen con base en la representatividad.

Por ejemplo, si a una persona se le describe una empresa y se le pide que prediga su rentabilidad futura, si la descripción de la empresa fue muy favorable, una rentabilidad muy alta parecerá más representativa de dicha descripción; y si la descripción es mediocre, una mala rentabilidad será más representativa. El grado en el que la descripción es favorable no es afectado por la ganancia de esa descripción o por el grado en el que permite hacer una predicción adecuada. Por lo tanto, si las personas predicen únicamente con base en los términos favorables de una descripción, sus predicciones serán insensibles a la confiabilidad de la evidencia y a la exactitud esperada de la predicción.

Este modo de juicio viola la teoría normativa estadística, en la cual la extremidad y el rango de las predicciones se controlan con base en consideraciones de predictibilidad. Cuando la predictibilidad es nula, la misma predicción debe hacerse en todos los casos. Por ejemplo, si las descripciones de ciertas empresas no proveen información relevante sobre las ganancias, entonces el mismo valor (como las ganancias promedio) debe ser predicho para esas empresas. Si la predictibilidad es perfecta, los valores predichos encajaran con los valores actuales y el rango de las predicciones será igual al rango de los resultados. En general, entre más alta sea la predictibilidad, más amplio será el rango de los valores predichos.

Muchos estudios de predicciones numéricas han mostrado que las predicciones intuitivas violan esta regla, pues las personas manifiestan poca preocupación, o ninguna, por las consideraciones de predictibilidad.

Otros sesgos cognitivos de la heurística de la representatividad que muestran Tversky y Kahneman en su primer artículo son “Ilusión de validez” y “Concepciones erróneas sobre la regresión”.

b) Heurística de disponibilidad

Hay situaciones en las que las personas evalúan la frecuencia o la probabilidad de un evento por la facilidad con la que casos u ocurrencias de dicho evento se pueden recordar. Por ejemplo, uno puede evaluar el riesgo de un ataque al corazón entre las personas de mediana edad recordando los casos entre gente conocida.

La disponibilidad es una pista útil para evaluar la frecuencia o la probabilidad de un suceso debido a que la ocurrencia de éste usualmente se recuerda mejor y más rápido que las ocurrencias de sucesos menos frecuentes. Sin embargo, se deben tomar en cuenta otros factores además de la frecuencia, pues confiar demasiado en la disponibilidad puede resultar en sesgos cognitivos.

- Recuerdo de ocurrencias o el sesgo de la recuperabilidad

Cuando un evento es juzgado por la disponibilidad de sus ocurrencias y éstas son fácilmente recuperables, parecerán más numerosas que las de un evento con igual frecuencia, pero cuyas ocurrencias son menos recuperables.

Para demostrar este efecto, a diferentes grupos de personas se les dictaron listas de personalidades conocidas de hombres y mujeres. Posteriormente se les pidió que juzgaran si en la lista correspondiente había más nombres de hombres o mujeres. En algunas listas los hombres mencionados eran más famosos que las mujeres, y en otras las mujeres mencionadas eran más famosas que los hombres. Dependiendo de la lista que le tocó a cada grupo, las personas erróneamente juzgaron que el sexo que tenía más personalidades conocidas era el más numeroso. A eso se le conoce como familiaridad.

Además de la familiaridad, existen otros factores, como la prominencia, la cual afecta la recuperabilidad de ocurrencias. Por ejemplo, el impacto para la probabilidad subjetiva de ver una casa quemarse, es más grande que leer sobre un incendio en un periódico. Aún más, las ocurrencias recientes de algún evento son más fácil de recuperar que las pasadas.

- Sesgo por la efectividad de la búsqueda

En una muestra de palabras al azar de un texto ¿es más probable que las palabras empiecen con la letra “r” o que ésta se encuentre en la tercera posición?

Las personas tratan de resolver este problema recordando palabras que empiezan con “r” (reloj) y palabras que tienen “r” en la tercera posición (martes) y evalúan la frecuencia por la facilidad con la que pueden recordar palabras de ambos tipos. Debido a que es más sencillo buscar palabras con “r” al inicio, que palabras que tengan dicha letra en la tercera posición, la mayoría de las personas cree que las primeras son más comunes.

- Sesgo por la imaginación

A veces tenemos que evaluar la probabilidad de sucesos cuyas ocurrencias no se encuentran en la memoria, no obstante, se pueden imaginar. En esos casos uno generalmente produce varias ocurrencias y evalúa la frecuencia o la probabilidad con base en la facilidad con la que ocurrencias relevantes se generan en la imaginación. Sin embargo, la facilidad con la que se generan ciertas ocurrencias no siempre refleja su probabilidad real.

La imaginación juega un papel importante en la evaluación de probabilidades en situaciones reales. Por ejemplo, la probabilidad de morir en un accidente de avión es ridículamente baja, a pesar de ello a muchas personas les da miedo viajar en este medio de transporte, pues infieren la probabilidad de dicho suceso con base en las ocurrencias que pueden recordar –noticias de accidentes de aviones. Cuando nuestra capacidad para imaginar ocurrencias de un suceso se ve afectada por otra cosa además de la frecuencia del suceso, la heurística de disponibilidad sistemáticamente sesgará la probabilidad estimada.

- Correlación ilusoria

En 1967 los psicólogos Jean P. Chapman y Loren J. Chapman describieron un sesgo cognitivo en el juicio sobre la frecuencia con la que dos eventos ocurren conjuntamente.

Estos psicólogos presentaron a dos individuos información sobre varios enfermos mentales hipotéticos. Los datos de cada paciente consistieron en un diagnóstico clínico y un dibujo de una persona hecho por el paciente. Posteriormente los dos individuos estimaron la frecuencia con la que cada diagnóstico (por ejemplo, paranoia) estaba acompañado de un dibujo con características particulares (como ojos sospechosos). Estos individuos sobrestimaron demasiado la frecuencia de los eventos conjuntos como asociaciones naturales. Por ejemplo, los pacientes diagnosticados con paranoia dibujan ojos sospechosos. A este efecto se le llama correlación ilusoria.

Los juicios erróneos de estos individuos en torno a los datos que se les habían mostrado hicieron evidente la tradición clínica sobre la interpretación de la prueba de dibujar a una persona. El efecto de la correlación ilusoria es muy resistente a contradicciones, persiste aun cuando la correlación entre el síntoma y el diagnóstico es negativa. En este caso impidió que los dos individuos detectaran relaciones que estaban presentes.

La disponibilidad da cabida a la correlación ilusoria. El juicio sobre qué tan seguido ocurren dos eventos conjuntamente se puede basar en la fuerza del vínculo asociativo entre ellos. Cuando se asocian fuertemente, es común concluir que los eventos se dan en pares de manera frecuente. En consecuencia, se juzgará que los eventos con fuertes asociaciones ocurren juntos casi siempre. De acuerdo con este punto de vista, por ejemplo, la correlación ilusoria entre la paranoia y los dibujos de personas con ojos sospechosos se debe al hecho de que la paranoia se asocia más con los ojos que con cualquier otra parte del cuerpo.

c) Heurística de ajuste y anclaje

En muchas ocasiones las personas hacen estimaciones partiendo de un valor inicial que se ajusta al producto final de la respuesta. El valor inicial, o el punto de partida, puede surgir de la formulación del problema o puede ser resultado de un cálculo parcial. En cualquier caso, dichos ajustes por lo general son insuficientes. Esto se debe a que diferentes puntos de partida producen estimados diferentes, los cuales están sesgados hacia los valores iniciales. A esto se le llama anclaje.

- Ajuste insuficiente

Para demostrar el efecto anclaje, a varios grupos se le pidió que estimaran algunas cantidades, como el porcentaje de los países Africanos miembros de la Organización de las Naciones Unidas (ONU). Para cada cantidad, un número entre 0 y 100 se determinó girando una ruleta en frente de los grupos. Posteriormente se les pidió que estimaran el valor de la cantidad en un rango superior o inferior en relación con el número que había salido en la ruleta. A los diferentes grupos se les dieron números distintos para cada cantidad. Dichos números arbitrarios tuvieron un efecto evidente en las estimaciones, por ejemplo, las estimaciones medias del porcentaje de los países Africanos miembros de la ONU fueron 25 y 45 para grupos que recibieron 10 y 65, respectivamente, como valor inicial. Las remuneraciones por exactitud no redujeron el efecto anclaje.

- Sesgos en la evaluación de eventos conjuntivos y disyuntivos

En un estudio, a varios individuos se les dio la oportunidad de apostar en uno de dos eventos. Se usaron tres tipos de eventos: 1) eventos simples, como coger una canica roja de una bolsa que contiene 50 por ciento de canticas rojas y 50 por ciento de canicas blancas; 2) eventos conjuntivos, como coger una canica roja siete veces seguidas de una bolsa que contiene 90 por ciento de canicas rojas y 10 por ciento de canicas blancas; 3) eventos disyuntivos, como coger una canica roja por lo menos una vez en siete intentos de una bolsa que contiene 10 por ciento de canicas rojas y 90 por ciento de canicas blancas.

En este problema, la mayoría de los individuos prefirieron apostar en el evento conjuntivo, cuya probabilidad es de .48 por ciento, en vez de apostar en el evento simple, cuya probabilidad es de .50 por ciento. Asimismo, prefirieron apostar en el evento simple en vez de en el disyuntivo, cuya probabilidad es de .52 por ciento. Por lo tanto, la mayor parte de los individuos prefirió apostar en el evento con menos oportunidades de ganar en todos los casos.

Dicho patrón de elección ilustra un descubrimiento general. Los estudios sobre elección entre apuestas y juicios de probabilidad indican que las personas tienden a sobrestimar la probabilidad de los eventos conjuntivos y a subestimar la probabilidad de los disyuntivos. Estos sesgos son fácilmente explicados como efectos de anclaje.

Los sesgos en la evaluación de eventos compuestos son particularmente importantes en la planeación. El éxito en la realización de un proyecto, como el desarrollo de un nuevo producto, por lo general tiene un carácter conjuntivo: para que un proyecto tenga éxito, deben ocurrir una serie de eventos. Hasta cuando cada uno de dichos eventos es muy probable, la probabilidad general de éxito puede ser bastante baja si los eventos son muchos. La tendencia general de sobreestimar la probabilidad de los eventos conjuntivos genera un optimismo injustificado en la evaluación de la probabilidad sobre el éxito del proyecto.

Al contrario, las estructuras disyuntivas generalmente se encuentran en la evaluación de riesgos. Un sistema complejo, como un reactor nuclear o el cuerpo humano, fallarán si cualquiera de sus componentes esenciales deja de funcionar. Incluso cuando la probabilidad de alguna falla en cualquier componente es mínima, la probabilidad de una falla general puede ser alta si muchos de los componentes están involucrados. Debido al anclaje, las personas tienden a subestimar las probabilidades de falla de los sistemas complejos.

La dirección del sesgo por anclaje a veces se puede inferir de la estructura del evento. La estructura en cadena de los eventos conjuntivos lleva a la sobrestimación, y la estructura en forma de embudo de los eventos disyuntivos, lleva a la subestimación.

Otro sesgo cognitivo de la heurística de ajuste y anclaje que describen Tversky y Kahneman en su primer artículo es el de “Anclaje en la evaluación de distribuciones de probabilidad subjetiva”.

Teoría Prospectiva

La Teoría Prospectiva de Tversky y Kahneman se publicó en su segundo artículo –1979. Como se vio, en el primer artículo que publicaron se enfocaron en cómo las heurísticas determinan inferencias probabilísticas. En este segundo trabajo se enfocaron en las probabilidades y en cómo éstas forman las decisiones de los consumidores y los resultados de ello.

Los estudios experimentales que llevaron a cabo mostraron una serie de anomalías que violan la teoría de utilidad esperada de la economía neoclásica, la cual se usa como herramienta para analizar situaciones en las que las personas deben tomar decisiones sin saber cuáles serán los posibles resultados, es decir, la toma de decisiones bajo incertidumbre. La teoría de utilidad esperada asegura que las personas escogen la acción que resultará en la utilidad esperada más alta, es decir, optimización.

Para demostrar lo anterior, probaron que se pueden generar cambios predecibles y dramáticos de preferencia con base en cómo se plantea un problema. A esto último se le llama efecto marco.

- Efecto marco

Uno de los estudios experimentales fue el siguiente:

Opción uno:

A un individuo se le dan 1000 dólares además de su riqueza actual. Posteriormente se le pide que escoja entre:

- Apostar entre ganar 1000 dólares más o no ganar nada (0). La probabilidad de ganar o perder es del 50 por ciento, respectivamente;

- No apostar y retirarse con 500 dólares más. La probabilidad de llevarse dicha suma de dinero es del 100 por ciento.

El 16 por ciento de los individuos que participó en este experimento tomó la opción a; el 84 por ciento, la b.

Como es evidente, la mayoría de las personas prefieren llevarse los 500 dólares más en vez de apostar. Esto es consistente con el comportamiento de aversión al riesgo, que es lo más común cuando las personas se encuentran frente a este tipo de situaciones. Asimismo, es la mejor decisión según la teoría de la utilidad esperada.

Opción dos:

A un individuo se le dan 2000 dólares además de su riqueza actual. Posteriormente se le pide que escoja entre:

- Apostar entre perder 1000 dólares o perder los 2000. La probabilidad de ganar o perder es del 50 por ciento, respectivamente;

- No apostar y retirarse dejando 500 dólares. La probabilidad de perder dicha suma de dinero es del 100 por ciento.

Bajo este planteamiento 69 por ciento de las personas tomó la opción a; 31 por ciento, la b.

Este último resultado se debe al efecto marco, el cual es un sesgo cognitivo. Esto significa que las personas deciden con base en la manera en que se les platea un problema.

En la opción dos los individuos en vez de mostrar aversión al riesgo, como en la opción uno, mostraron un comportamiento que busca el riesgo. Esto se debe a que el problema en la opción uno está enmarcado como una ganancia y en la opción dos como una pérdida.

No obstante, si se analiza el resultado de la opción dos, no tiene sentido de acuerdo con la teoría de la utilidad esperada de la economía neoclásica. Además, aunque el planteamiento sea diferente, se trata exactamente del mismo problema en ambos casos, pues la utilidad esperada es la misma (1500 dólares). Uno de los supuestos de la economía racional es que las personas no son susceptibles al efecto marco, pero este experimento justamente es una manipulación que lleva a las personas a caer en dicho efecto.

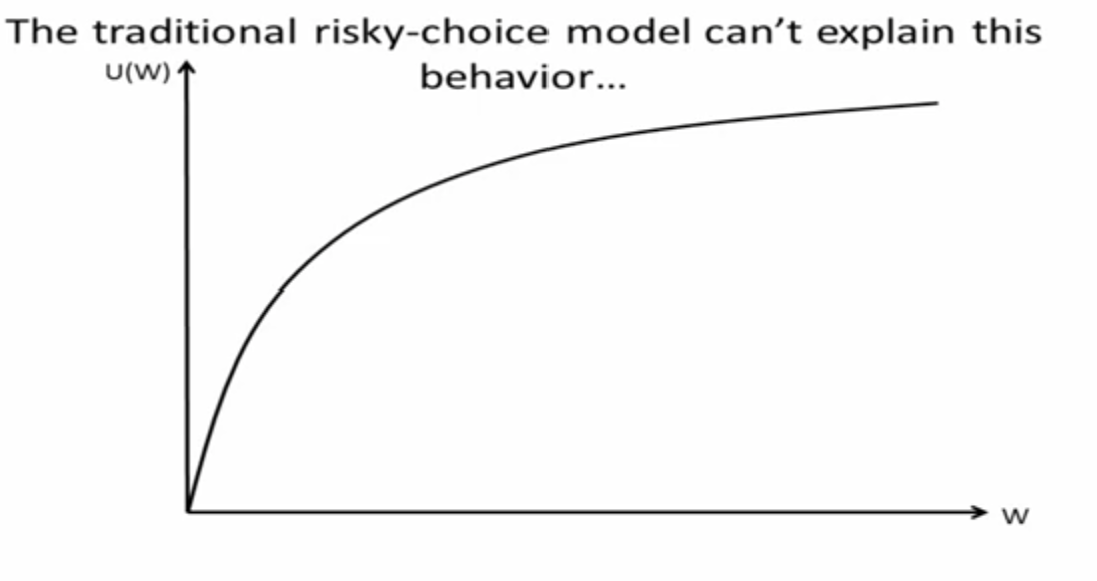

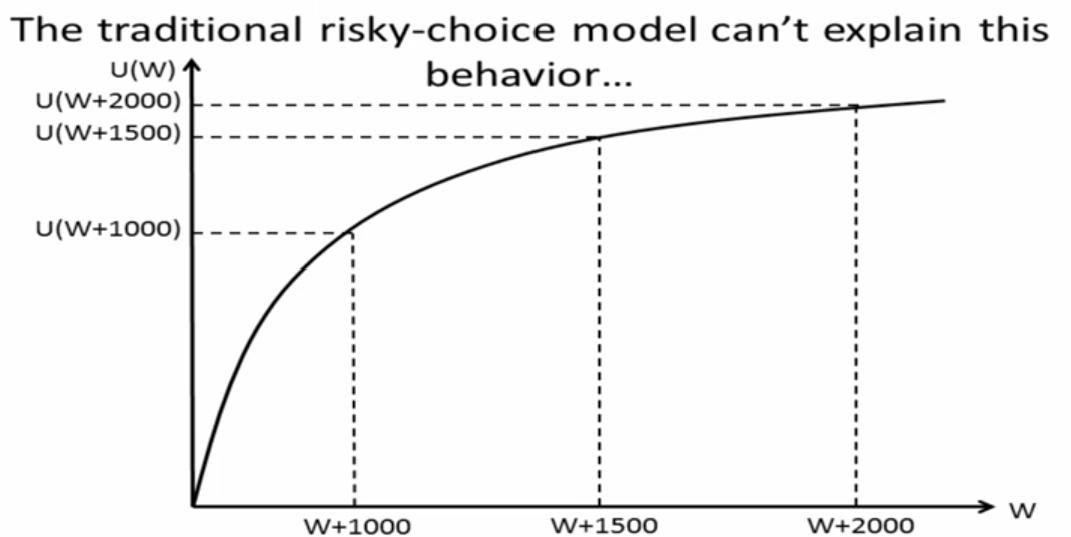

En un modelo de elección arriesgada los resultados no se pueden explicar. Esto es claro si se observa en una función de utilidad, esto es, una función que con base en una asignación de valores numéricos, mide la satisfacción o utilidad.

Fuente: Beggs, J. (2015). The motivation for Prospect Theory. Recuperado de https://www.youtube.com/watch?v=9m6hTHDXxAc

La U significa utilidad y la W riqueza. La función representa la utilidad de cierto grado de riqueza.

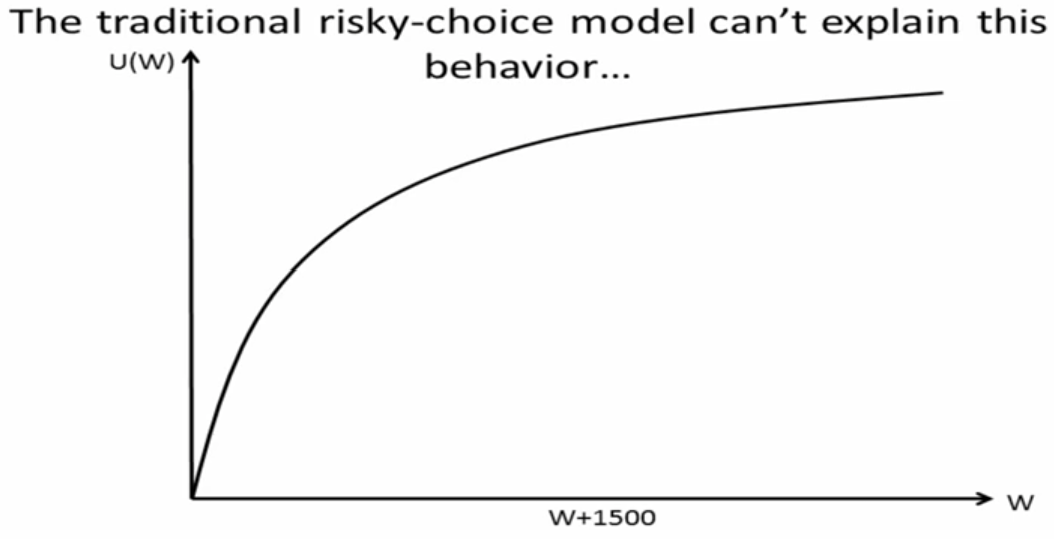

Si pensamos el problema planteado en la opción uno en términos de riqueza final cuando un individuo tiene un comportamiento de aversión al riesgo, es decir, cuando a un individuo se le dan 1000 dólares y después decide quedarse con 500 dólares en vez de apostar entre ganar 1000 o no ganar nada, entonces, el resultado de la primera opción del problema es que la riqueza final del individuo serán 1500 dólares, más el nivel de riqueza que éste ya poseía. Este caso se ve así:

Fuente: Beggs, J. (2015).

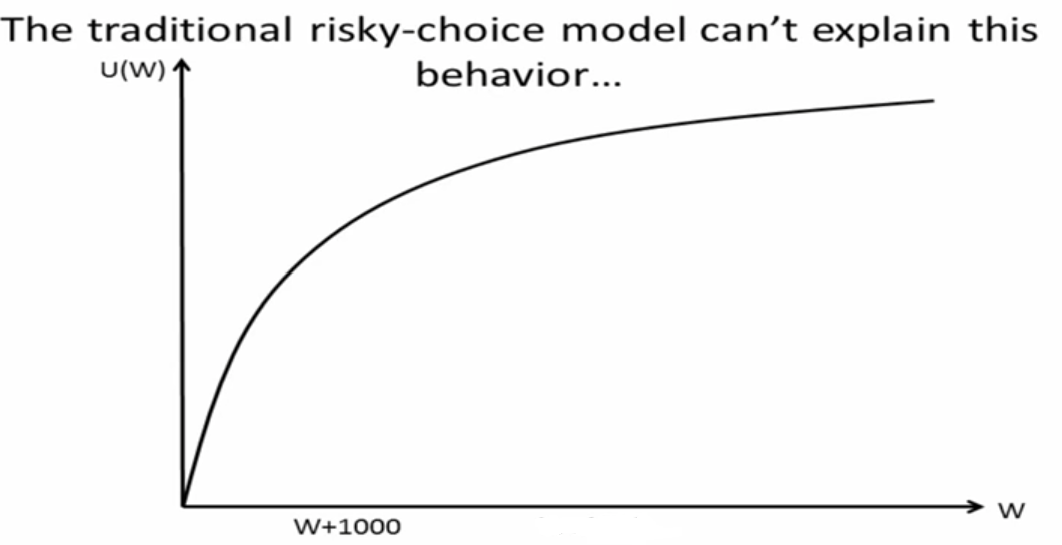

Si el individuo en la opción uno del problema tiene un comportamiento que busca el riesgo y decide apostar entre 1000 dólares más o nada, entonces un posible resultado es que pierda la apuesta y se quede con los 1000 dólares que se le dieron inicialmente, más la riqueza que ya poseía. Este caso se ve así:

Fuente: Beggs, J. (2015).

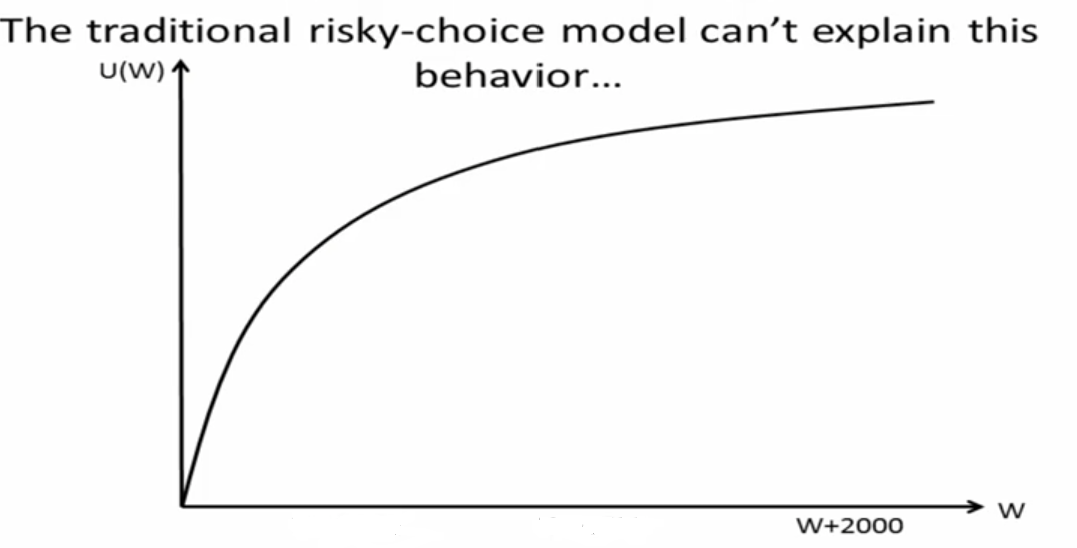

En caso de que el individuo en la opción uno del problema gane la apuesta, entonces su riqueza final serán 2000 dólares, más la riqueza que ya poseía. Este caso se ve así:

Fuente: Beggs, J. (2015).

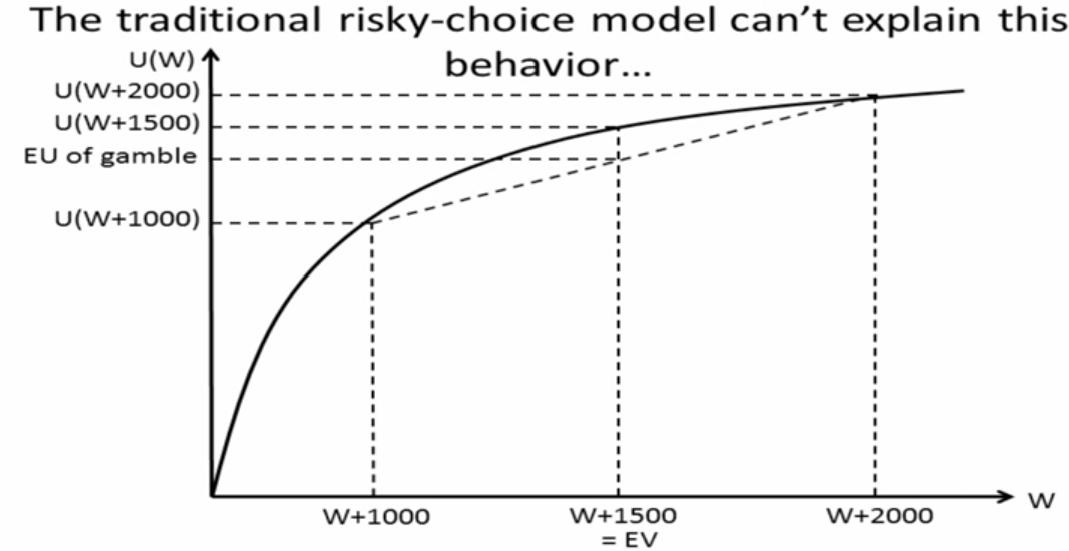

En la siguiente función se hace patente la utilidad de cada cantidad más la riqueza que ya poseía el individuo:

Fuente: Beggs, J. (2015).

En la siguiente función se ve la utilidad esperada (EU) del problema, que es el punto en el segmento de línea entre los dos posibles resultados, lo cual corresponde al valor esperado (EV). Es decir, la utilidad esperada son 1500 dólares.

Fuente: Beggs, J. (2015).

Entonces, de acuerdo con el modelo de utilidad esperada de la economía tradicional, no es sorprendente que la mayoría de las personas escojan no apostar en la opción uno, y mejor decidan quedarse con los 1000 dólares que se les dieron inicialmente más los 500 dólares que se les ofrecieron.

Ahora, considerando la opción dos, en la que a las personas se les dieron inicialmente 2000 dólares, si el resultado es el que la economía neoclásica califica como el más racional, es decir, quedarse con la utilidad esperada, entonces se les quitan 500 dólares, de tal manera que su riqueza final serán 1500 dólares, más lo que ya poseían.

En caso de que algún individuo decida tomar la apuesta y gane, entonces su riqueza final serán 2000 dólares, más lo que ya poseía; si pierde la apuesta, su riqueza final serán 1000 dólares, más lo que ya poseía.

Es evidente que si se usa el modelo de utilidad esperada para presentar ambas opciones, es imposible explicar el comportamiento de las personas cuando se les plantea la opción dos, pues dicho modelo establece que si prefieres un resultado x, lo preferirás independientemente de cómo se te plantee el problema.

Este experimento manifiesta que la economía neoclásica deja lagunas sin resolver al considerar a los seres humanos como puramente racionales. La irracionalidad es patente, pero esto no significa estupidez, sino que muestra inconsistencias específicas o sesgos que usamos comúnmente en la toma de decisiones.

- Función del valor

Una conclusión del estudio experimental del efecto marco es que a las personas no les gustan las pérdidas, pues aun con el modelo de utilidad esperada más dinero es mejor que menos dinero. Por lo tanto, sin importar el modelo que se use para ver esto, un hecho es que las pérdidas son insatisfactorias. Esto se puede considerar un aspecto consistente del comportamiento humano.

Además, es necesario señalar que de hecho las pérdidas causan mayor desagrado de lo que causan satisfacción ganancias equivalentes. Por lo tanto, un sesgo en la toma de decisiones se puede construir planteando un problema en términos de pérdida en vez de en términos de ganancia, aunque sea exactamente el mismo problema.

Dicho de otro modo, esta asimetría, es decir, el hecho de que las personas encuentren más desagradables las pérdidas de lo que encuentran satisfactorias las ganancias, es lo que da cabida al efecto marco. Si pensaran las pérdidas y las ganancias de manera simétrica, no serían susceptibles a este efecto.

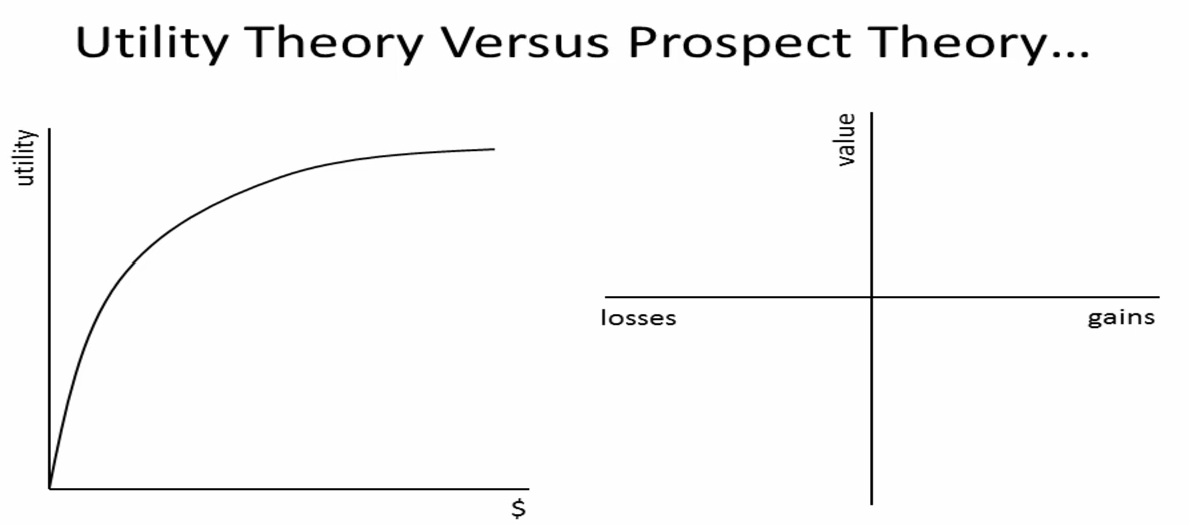

Por lo tanto, si se quiere describir el comportamiento de las personas en vez de describir la manera en la que deberían comportarse, como lo hace la teoría normativa de la economía neoclásica, es necesario un modelo alternativo al de la utilidad esperada. Esto lo lleva a cabo la Teoría Prospectiva.

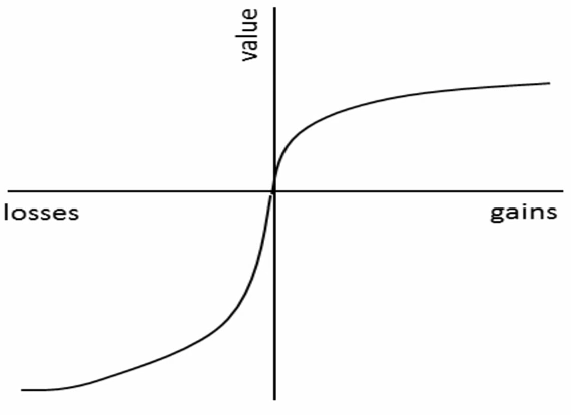

Fuente: Beggs, J. (2015). The Prospect Theory Value Function. Recuperado de https://www.youtube.com/watch?v=GnhGxEKIb5c&t=774s

La Teoría Prospectiva presenta la función del valor, aquella que se observa a la derecha en la imagen, la de la izquierda es la función de utilidad. En el eje vertical de la función del valor se mide el valor (value), y en el eje horizontal las pérdidas (losses) y las ganancias (gains).

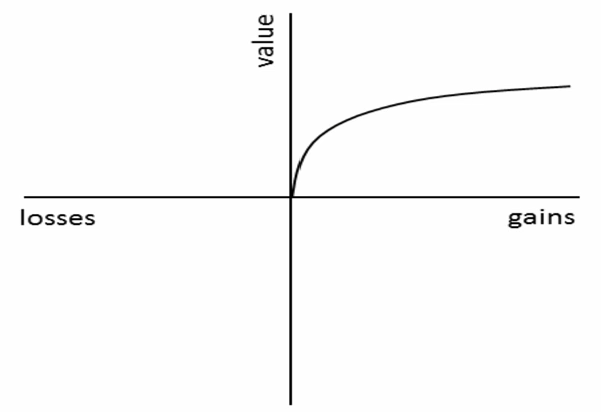

Cuando se nos plantea un problema en términos de ganancia, la función del valor se parece mucho a la función de utilidad, como se puede observar en la siguiente imagen.

Fuente: Beggs, J. (2015).

Son embargo, una característica importante de la función del valor en contraste con la función de utilidad, es que el eje horizontal no mide el nivel de riqueza, sino las pérdidas y las ganancias. De esta manera la Teoría Prospectiva asume que las personas toman decisiones con base en las posibles pérdidas o ganancias, y los cambios que pueden suponer. Esto también es muy diferente a lo que asume la economía neoclásica expresándose en la función de utilidad, pues considera que las personas toman decisiones monetarias tomando en cuenta los cambios en relación con su riqueza total.

En otras palabras, la economía neoclásica asume que cuando tomamos decisiones, como comprar una medicina de 1000 dólres que nos curará de una grave enfermedad, no lo vemos como un gasto, pues pensamos en la riqueza total que poseemos y en la utilidad de comprar la medicina, en tal caso 1000 dólares no supone nada. Sin embargo, las personas no piensan así cuando toman una decisión.

Entonces, lo que también muestra la función del valor es que las personas consideran las pérdidas y las ganancias desde un punto de referencia neutral. No es claro cómo se forma el punto de referencia neutral, pero es patente que categorizamos las decisiones como pérdidas o ganancias.

Por otro lado, es importante observar en la función del valor cómo se desvía la línea de la curva, pues en vez de seguir con la forma cóncava que se observa en el cuadrante de las ganancias, cuando pasa al cuadrante de las pérdidas hay un punto de inflexión y toma una forma convexa, como se puede notar en la siguiente imagen.

Fuente: Beggs, J. (2015).

Para que esta función sea clara se tiene que entender que consideramos las decisiones que tomamos como pérdidas o ganancias en relación con nuestro estado psicológico o punto de referencia neutral, el cual no es claro cómo se genera, puede generarse de diferente manera en distintas circunstancias y potencialmente puede ser manipulado. Lo que es evidente es que tenemos un punto de referencia con base en el cual juzgamos las pérdidas y las ganancias.

Ahora, el cuadrante de las ganancias, cuya forma es cóncava, es igual a la función de utilidad, pues muestra el comportamiento de aversión al riesgo; el cuadrante de las pérdidas, cuya forma es convexa, lo que muestra es el comportamiento que busca el riesgo. Asimismo, en el cuadrante de las pérdidas se puede observar una forma más empinada. Entonces, la forma en S de la función del valor lo que describe es el comportamiento que se observa cuando una decisión se percibe como una ganancia o como una pérdida.

Así pues, en ambos casos, es decir, en el cuadrante de ganancias y en el de pérdidas, se puede observar que la utilidad marginal decrece o, en otras palabras, se produce una valoración decreciente. Esto se observa en el punto en el que la curva se va haciendo plana. Entonces, la función del valor muestra cómo las personas se van desensibilizando ante las ganancias y las pérdidas.

Lo dicho es empíricamente consistente en cuanto a las ganancias, no obstante, en el caso de las pérdidas no lo es, pues el punto en donde se comienza a aplanar la curva indica que las personas prefieren juntar pérdidas, por ejemplo, un individuo prefiere el mismo día reprobar un examen importante y que se muera su perro. Sin embargo, cuando se le pregunta a las personas si prefieren juntar o separar pérdidas de este tipo, lo más común es que prefieran separarlas. Por lo tanto, en cuanto a la desensibilización en el caso de las pérdidas, la función no es consistente con lo que se observa empíricamente.

Lo que sí es consistente con lo que se aprecia empíricamente, reitero, es que cuando a las personas se les plantea un problema en términos de pérdida, muestran un comportamiento que busca el riesgo. Este hecho es lo que hace que en el cuadrante de pérdidas la curva tome esa forma.

Ahora, lo que se puede considerar como la causa de que las personas prefieran buscar el riesgo cuando se les plantea un problema en términos de pérdida, es que si existe una mínima probabilidad de no perder nada, optan por esa opción. Para que se entienda, en el experimento que se describió anteriormente, cuando el problema se planteó en términos de pérdida, la mayoría de las personas optó por apostar a perder la mitad de lo que tenía o no perder nada (1000 dólares o 2000), en vez de solo perder un cuarto (500 dólares).

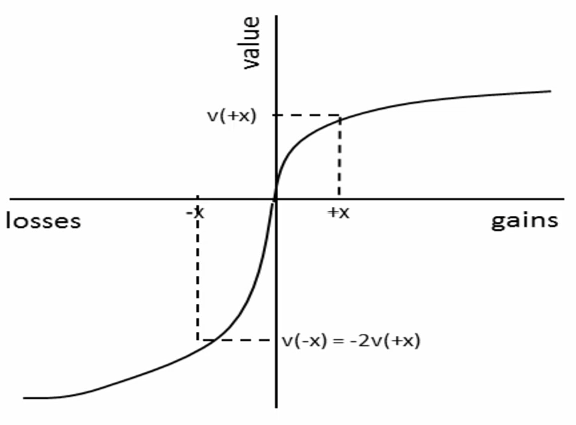

Por otro lado, una regla general es que las pérdidas y las ganancias difieren por un factor de dos. Esto se puede observar en la siguiente imagen.

Fuente: Beggs, J. (2015).

Esta gráfica básicamente señala lo dicho anteriormente, a saber, que las personas consideran más desagradables las pérdidas de lo que consideran satisfactorias ganancias equivalentes.

Ahora, la función del valor de la Teoría Prospectiva explica el comportamiento irracional con base en dos efectos, estos son, el efecto reflexión y el efecto aislamiento. El efecto reflexión se refiere a que, como muestra la forma en S de la función, las preferencias de las personas se pueden cambiar modificando el planteamiento de los problemas en términos de pérdida o ganancia. Por ejemplo, en el caso del problema descrito anteriormente, en la opción uno (problema planteado en términos de ganancia), las personas prefirieron llevarse 500 dólares más en vez de apostar entre ganar 1000 dólares más o no ganar nada; sin embargo, en la opción dos (problema planteado en términos de pérdida), las personas prefirieron apostar entre mantener 2000 o perder 1000, en vez de solo perder 500 dólares. Es decir, en lo único en lo que cambió el problema fue en que en la opción uno éste se percibió en términos positivos –500 más en contra de nada o 1000 más– y en la opción dos se percibió en términos negativos –1000 menos o 500 menos–, y esto fue suficiente para cambiar la preferencia de las personas sobre qué decisión tomar.

El efecto aislamiento se refiere a que las personas no suman las pérdidas y las ganancias a su riqueza total. Asimismo, no suman las pérdidas y las ganancias en un contexto individual, como se muestra en el ejemplo anterior. Para que sea claro, en la opción uno las personas no tomaron en cuenta los 1000 dólares que se les dieron inicialmente y después consideraron como una ganancia más los 500 dólares que se les ofrecieron en vez de apostar; y en la opción dos, sin considerar los 2000 dólares que se les dieron inicialmente, efectivamente, percibieron como una pérdida que se les quitaran 500 dólares y prefirieron apostar entre perder 1000 dólares o quedarse con los 2000.

El efecto aislamiento permite ciertas estrategias en el mercado, pues si las personas se enfocan mucho en pequeñas pérdidas monetarias que realmente no afectan su riqueza total, es posible que opten por servicios que no necesitan. Por ejemplo, algunas aseguradoras en vez de ofrecer servicios importantes, como seguros de vida, usan el efecto aislamiento para atraer clientes, ofreciendo seguros sobre cosas insignificantes, como los seguros de celulares o los seguros funerarios, cuyo surgimiento data antes de Cristo.

Los errores en la toma de decisiones no son sorprendentes, pues si el procesar información para tomar una decisión requiere mucho esfuerzo, buscaremos la manera de hacerlo más sencillo. Por ejemplo, una estrategia que usamos para tomar decisiones es fijarnos en las diferencias en vez de en las similitudes, lo cual muchas veces resulta útil, pero en el caso del problema anterior, esto no funciona, pues es lo que causa que caigamos en el efecto marco. Asimismo, muchas otras estrategias que usamos en la toma de decisiones nos hacen caer en los otros sesgos cognitivos mencionados anteriormente.

- Función de ponderación

Tómese en consideración el siguiente estudio experimental:

A un grupo de personas se les dan a escoger dos opciones, a saber:

- 25 por ciento de ganar 3000 dólares, o;

- 20 por ciento de ganar 4000 dólares.

Al mismo grupo de personas posteriormente se le dan a escoger otras dos opciones, a saber:

- 100 por ciento de ganar 3000 dólares, u;

- 80 por ciento de ganar 4000 dólares.

En el primer caso, el 17 por ciento de las personas escogió la opción a, y el 83 por ciento la opción b; en el segundo caso, el 82 por ciento escogió la opción a, y el 18 por ciento la b.

Las respuestas de los participantes no tienen sentido desde el punto de vista de la teoría de la utilidad esperada, pues las probabilidades de un caso a otro solo se multiplicaron por cuatro, es decir, la utilidad esperada de un caso a otro solo es cuatro veces mayor pero, en sí, es la misma utilidad.

A este estudio experimental se le conoce como la paradoja de Allais, pues viola la teoría de la utilidad esperada. Dicha teoría sostiene que la utilidad de los resultados es pesada por sus probabilidades, no obstante, como se mostró en el ejemplo, las preferencias de las personas violan sistemáticamente este principio.

Lo que manifiesta el estudio es que las personas tienden a exagerar el peso de los resultados que considerar certeros. A este fenómeno se le denomina efecto de certidumbre.

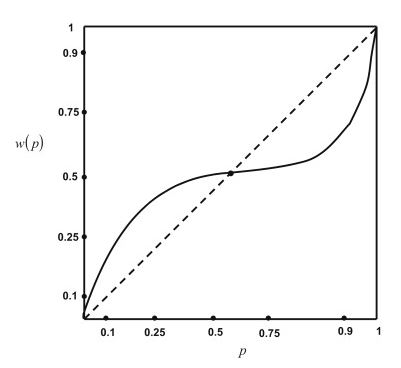

Entonces, lo que la función de ponderación de Tversky y Kahneman muestra es que las personas distorsionan las probabilidades en su mente al exagerar el peso de los extremos. Este patrón se puede observar en la siguiente gráfica, en donde las probabilidades objetivas (p) se encuentran en el eje horizontal y el peso de las decisiones (w(p)) en el eje vertical.

Tresch, W. R. (2015). Behavioral Public Sector Economics. Recuperado de https://www.sciencedirect.com/science/article/pii/B978012415834400025X

El segmento muestra que las personas tienden a pesar la probabilidad objetivamente solo cuando hay certeza, en donde p y w(p) son iguales a cero o uno. Cuando no hay certeza, el peso de las decisiones(w(p)) excede las probabilidades objetivas (p), aumentando cuando la probabilidad es baja, y disminuyendo cuando la probabilidad es alta. La divergencia va en aumento en ambos sentidos hasta que la probabilidad es cercana a 0 o 1. Esto significa que las personas son propensas a exagerar los resultados extremos en relación con sus probabilidades objetivas, y esto solo se corrige cuando los extremos son certeros.

Para que se entienda esta idea, podemos recordar la heurística de disponibilidad y uno de los sesgos a los que lleva, a saber, el sesgo por la imaginación.

Este sesgo se da cuando al evaluar la probabilidad de sucesos cuyas ocurrencias no se encuentran en la memoria, se recurre a la imaginación. En estos casos uno generalmente produce varias ocurrencias y evalúa la probabilidad con base en la facilidad con la que ocurrencias relevantes se generan en la imaginación. Sin embargo, la facilidad con la que se generan ciertas ocurrencias no siempre refleja su probabilidad real.

Por ejemplo, la probabilidad de morir en un accidente de avión es ridículamente baja, a pesar de ello a muchas personas les da miedo viajar en este medio de transporte, pues infieren la probabilidad de dicho suceso con base en las ocurrencias que pueden recordar –noticias de accidentes de aviones, las cuales son demasiado sobresalientes porque de hecho son pocas. Entonces, cuando nuestra capacidad para imaginar ocurrencias de un suceso se ve afectada por otra cosa además de la frecuencia del suceso, la heurística de disponibilidad sistemáticamente sesga la probabilidad estimada.

Entonces, con el ejemplo anterior se entiende por qué tendemos a exagerar el peso de las probabilidades cuando se encuentran cerca de los extremos.

Esta desviación del comportamiento racional también la aprovecha el mercado, con ello podemos explicar por qué existen seguros para aviones o seguros de terremoto.

Por otro lado, el pesar las probabilidades de esta manera da cabida a equivocarse de dos maneras, a saber, literalmente pensar que la probabilidad de sufrir un accidente de avión es más alta de lo que realmente es u, objetivamente saber cuál es la probabilidad de que dicho suceso ocurra, no obstante, subjetivamente decidir que ese número es más importante de lo que realmente es.

Por lo tanto, el peso que se le da a las probabilidades no representa un error en el sentido de que las personas no entiendan probabilidades objetivas, sino que subjetivamente las sobreestiman o las subestiman y con base en ello deciden no tomar en cuenta las probabilidades objetivas cuando toman una decisión.

Finanzas del comportamiento

La economía neoclásica asume que los mercados son eficientes, es decir, racionales, pues se cree que los activos, como las acciones y los bonos, mantienen su valor real debido a que los inversionistas compran activos infravalorados y venden los sobrevaluados. Por lo tanto, también supone que los inversionistas son racionales, pues se cree que tienen autocontrol, no se dejan llevar por sesgos cognitivos y no tienen errores en el proceso de información.

Dichos supuestos han dado cabida a que no haya consenso en los mercados financieros sobre una pregunta fundamental, a saber, ¿cuál es la causa de las fluctuaciones en el mercado bursátil e inmobiliario?

En las finanzas del comportamiento, por el contrario, se considera que los inversionistas son tan racionales e irracionales como cualquier otro ser humano, pues tienen límites en el autocontrol y se dejan llevar por sesgos cognitivos, lo que los lleva a tomar malas decisiones. De esta manera, las finanzas del comportamiento se encuentran en desacuerdo con la idea sobre los mercados eficientes.

Robert Shiller, uno de los mayores exponentes de las finanzas del comportamiento y ganador del Premio Nobel de economía en 2013, presentó un análisis que refuta la teoría de los mercados eficientes en una conferencia Nobel sobre economía.

Algo empíricamente contradice la teoría de los mercados eficientes, no obstante, los economistas tradicionales tienden a no creerlo, es un fenómeno llamado “burbuja financiera o especulativa”. Esto se da cuando algún mercado se pone de moda y los inversionistas, irracionalmente, invierten en él, haciendo que los precios de las acciones de dicho mercado aumenten cada vez más. Esta situación se mantiene por un tiempo, pero eventualmente los precios caen, la burbuja se revienta y, con ello, cae el mercado.

La teoría de los mercados eficientes sostiene que no existen las burbujas financieras debido a que el mercado es racional, es decir, los agentes incorporan eficientemente la información en los precios. Para que se entienda, el precio de una acción o de un portafolio de acciones, equivale a la expectativa matemática, ajustada a toda la información disponible en ese momento, del valor presente de dicha acción. El valor presente se refiere al método para calcular el valor o la utilidad que se recibirá de una inversión –como la compra de una acción, en cuyo caso el valor presente será sobre los dividendos, esto es, la ganancia que reparte una empresa entre sus accionistas– en el futuro. El valor presente de una inversión nunca se sabe en el momento en el que ésta se realiza, por lo que se tiene que pronosticar. La teoría de los mercados eficientes sostiene que el precio –de una acción, por ejemplo– equivale al mejor pronóstico del valor presente –dividendos.

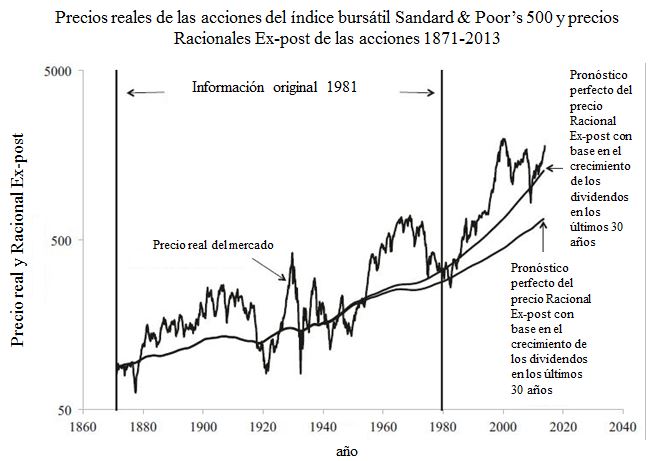

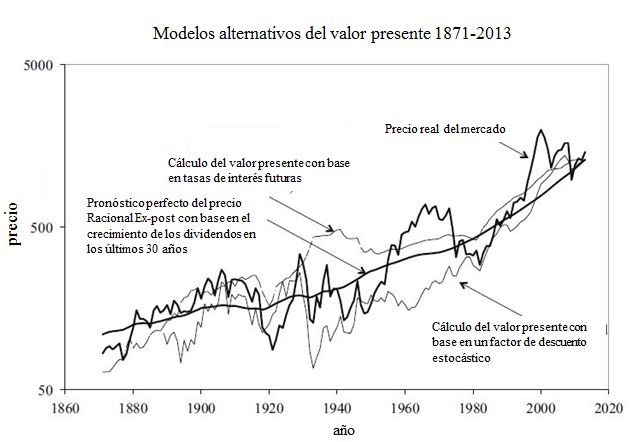

Fuente: Shiller, R. (2013). Speculative Asset Prices. (Traducción mía). Recuperado de https://www.nobelprize.org/uploads/2018/06/shiller-lecture.pdf

(Shiller llama “precios Racionales Ex-post de las acciones” al valor presente de los dividendos porque es el precio si se saben todos los futuros dividendos)

La gráfica muestra información histórica del índice bursátil Standard & Poor’s 500 (S&P 500).La línea más errática muestra el precio real de las acciones de dicho mercado de 1871 a 2013. En esta línea es patente la volatilidad (cambios en los precios de los activos). Asimismo, se pueden observar las caídas históricas de dicho mercado, como aquella de 1929, la del 2000, la de 2008, etc.

Por otro lado, si todos pudieran pronosticar de manera perfecta el futuro, es decir, si se pudiera saber el precio de todos los futuros dividendos, el mercado se hubiera comportado y se comportaría en el futuro como señalan las otras dos líneas, a saber, de manera estable. No obstante, el mercado real tiene muchas altas y bajas.

Shiller asevera que desde 1871 el valor de los dividendos ha seguido una tendencia, es decir, no ha aumentado o disminuido mucho. Por lo tanto, no hay una razón por la cual los precios de las acciones fluctúen como lo ha hecho históricamente según la economía neoclásica. Entonces, lo que muestra la gráfica refuta la teoría de los mercados eficientes en tanto es manifiesto que en el mercado de EE.UU se han generado burbujas financieras repetitivamente. Por ejemplo, en 1920 se puede observar claramente cómo comenzaron a subir los precios y, posteriormente, en 1929, cómo cayó el mercado; entre las décadas de 1950 y 1960 también se puede observar el surgimiento de una burbuja financiera, que posteriormente reventó en 1974.

Ahora, lo anterior también se puede probar con base en modelos alternativos del valor presente. Para calcular el valor presente por lo general se usan tasas de descuento constantes, no obstante, también se puede calcular con base en tasas de descuento que dependan de tasas de interés variables, o con base en un factor de descuento estocástico, esto es, tomando en cuenta todas las condiciones que pueden afectar al mercado.

Fuente: Shiller, R. (2013). (Traducción mía).

La gráfica muestra el precio real del mercado y el pronóstico perfecto del precio con base en los tres modelos para calcular el valor presente. Como es evidente, históricamente es mínima la correspondencia entre las tres medidas del valor presente o precio Racional Ex-post con el precio real del mercado. En otras palabras, ninguno de los modelos da una razón que explique la fluctuación de facto en el mercado.

De hecho, se puede notar que en ciertos puntos el precio que arrojan los modelos es contrario al precio real del mercado. Por ejemplo, el modelo del cálculo del valor presente con base en las tasas de interés futuras, apunta a que el precio de las acciones debió haber sido muy alto durante la Gran Depresión (1929-1939), pues las tasas de interés fueron muy bajas durante dicho periodo, no obstante, como se puede observar, el precio de éstas fue bajo.

Shiller sostiene que lo que explica las fluctuaciones en el mercado real son las burbujas financieras, es decir, modas que vienen y van, las cuales afectan psicológicamente a los inversionistas. Por ello considera –no asegura– que los modelos simples son poco eficaces para predecir el mercado.

El famoso economista John Maynard Keynes alguna vez se refirió al mercado como un concurso de belleza que en una ocasión encontró en un periódico. En éste se encontraban muchas fotografías de mujeres muy guapas, y pedían que los participantes seleccionaran las seis fotografías de las mujeres que les parecieran más guapas y las enviaran a las oficinas del periódico. Los ganadores serían aquellos cuya selección se acercara al promedio de las seis fotografías más seleccionadas. Keynes explicó que para ganar un concurso de ese estilo los participantes no deben seleccionar las imágenes de las mujeres que de hecho consideren más guapas, ni tampoco las de las mujeres que piensen que otros consideran más guapas, sino más bien las fotografías de las mujeres que los otros participantes crean que otros participantes consideran más guapas. Y explicó que exactamente de esta manera se comporta el mercado, pues los inversionistas no escogen poner su dinero en las acciones de las mejores corporaciones, sino en las acciones de las corporaciones que posteriormente subirán en el mercado. Entonces, parece que tratamos de adivinar los actos de los demás, lo cual no parece muy racional.

Ejemplos sobre burbujas financieras e irracionalidad en el mercado

- Fondo cerrado CUBA

Un gran ejemplo sobre cómo se forman las burbujas financieras y la irracionalidad que este fenómeno envuelve, lo presentó Richard Thaler, otro gran exponente de las finanzas del comportamiento, en una conferencia en la Universidad de Chicago.

Para empezar hay que aclarar qué es un fondo cerrado, a saber, un portafolio de activos agrupados que junta un monto de capital fijo a través de una oferta inicial pública y posteriormente enlista acciones para comerciarlas en la bolsa, pero no las comercia con base en su valor neto.

Entonces, en 1994 se creó un fondo cerrado llamado CUBA (Herzfeld Caribbean Basin Fund), el cual tiene 69 por ciento de sus inversiones en el mercado estadounidense y el resto en mercados extranjeros, principalmente en el mercado mexicano. Este fondo no invierte en el mercado cubano, pues, por un lado, en EE.UU esto es ilegal; y, por otro lado, los bonos soberanos de Cuba solo pueden ser adquiridos por el sistema bancario cubano, es decir, Cuba no vende sus títulos de valor al extranjero como cualquier otro país.

Por otro lado, históricamente este fondo cerrado ha operado con un descuento del 15 por ciento sobre el valor neto de los activos, es decir, una persona puede comprar 100 dólares del valor de los activos por 85 dólares.

Fuente: Thaler, R. (2016). Richard Thaler on Behavioral Economics: Past, Present and Future. (Traducción mía). Recuperado de https://www.youtube.com/watch?v=TJrpN5INvcs&t=2448s

La gráfica muestra el valor neto de los activos, que es la línea naranja, la cual es constante; y el precio de estos en el fondo CUBA, que es la línea verde, la cual es más errática y en un momento claro se va al alza. Específicamente subieron un 70 por ciento, esto es, una persona puede comprar 100 dólares del valor de los activos por 170 dólares.

Lo que causó este gran aumento en el precio de los activos del fondo CUBA fue el anuncio del ex mandatario estadounidense, Barack Obama, en diciembre de 2014, de relajar las relaciones con Cuba. Si se analiza, esto no tiene sentido, pues en EE.UU es imposible invertir en Cuba. No obstante, los precios se fueron al alza un 70 por ciento y se mantuvieron altos casi durante un año.

En noviembre de 2016, el precio de los activos del fondo CUBA volvió a subir, exactamente cuando murió Fidel Castro. Ahora, Castro tenía 90 años cuando murió, su condición en sus últimos años de vida no fue muy buena y dejó de dirigir el país mucho tiempo antes de su muerte. Por lo tanto, si las personas tuvieran expectativas racionales, estos eventos no hubieran causado que el precio de los activos del fondo CUBA se fuera al alza.

- Burbuja inmobiliaria

El mercado inmobiliario en EE.UU es muy grande, hasta 2013 su valor total era superior al valor total del mercado bursátil. Actualmente el mercado inmobiliario tiene un valor de 33.3 billones de dólares y el mercado bursátil tiene un valor de 34 billones. En otras palabras, las personas invierten en inmuebles casi lo mismo de lo que invierten en activos financieros

No obstante, hasta la década de 1980 casi no había información sobre la eficacia del mercado inmobiliario, pues bajo el supuesto de que los mercados son eficientes, muchos economistas asumían que este mercado también lo era.

Hasta ese momento lo único que había disponible para evaluar el mercado inmobiliario era el Índice de Calidad Constante (Constant Quality Index o Price of New Homes Sold), desarrollado por el Departamento del Censo de EE.UU. Este índice no se fijaba en las ventas repetidas, sino en el precio de casas estándar, es decir, de casas que tuvieran características específicas en cuanto a metros cuadrados, número de cuartos, número de estacionamientos, etc. Sin embargo, este índice no era útil para verificar la eficacia del mercado inmobiliario, ya que se enfocaba en precios de casas nuevas en diferentes épocas. Por ejemplo, las personas dejaban de construir en la ciudad cuando los precios de las casas subían, pues los terrenos también se encarecían, y comenzaban a construir en las afueras de la ciudad, en consecuencia, el índice de Calidad Constante registraba esos nuevos precios, los cuales no se ajustaban al aumento de los precios en la ciudad, sino a los antiguos precios.

Por lo dicho, en 1986, Shiller y Karl Case decidieron desarrollar un índice de precios de vivienda de ventas repetidas, es decir, un índice que se fijara únicamente en el movimiento de precios de viviendas existentes. El fin de este índice era hacerlo análogo al índice de precios de activos financieros, de tal manera que sirviera para evaluar las viviendas como inversión.

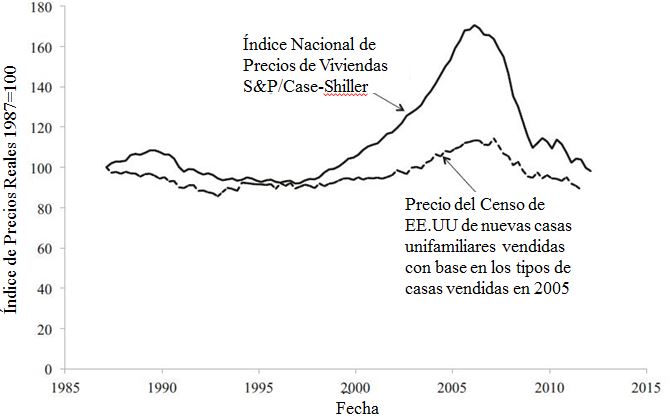

Fuente: Shiller, R. (2013). (Traducción mía).

La gráfica muestra cómo el índice de Shiller y Case, midiendo los precios de vivienda de ventas repetidas, logró localizar la burbuja financiera que se formó en la primera década del 2000. Asimismo, muestra cómo el Índice de Calidad Constante no reflejó la situación en su totalidad.

Lo llamativo de este movimiento en los precios de las casas es que aumentaron demasiado en poco tiempo, lo cual no se puede explicar con variables económicas.

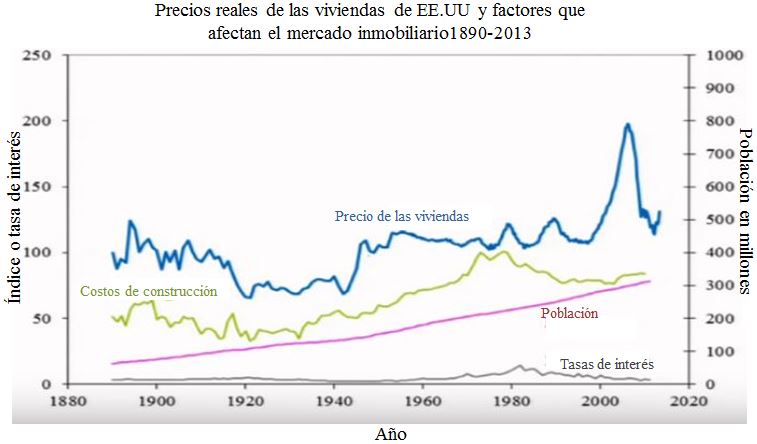

Fuente: Shiller, R. (2013). Speculative Asset Prices. (Traducción mía). Recuperado de https://www.youtube.com/watch?v=WzxZGvrpFu4

La gráfica muestra un intento de Shiller por representar los precios de las viviendas en EE.UU desde 1890 hasta 2013.

En ésta es patente que algunos de los factores que comúnmente afectan al mercado inmobiliario, como las tasas de interés, la población o los costos de construcción, no explican el rápido aumento y el casi inmediato colapso de éste en la primera década del siglo XXI.

Por lo tanto, éste fenómeno se puede juzgar como una burbuja en el mercado inmobiliario.

El surgimiento de dicha burbuja solo se entiende con base en la ineficiente regulación en el sistema financiero de EE.UU en aquella época, pues en el mercado hipotecario se llevaron a cabo una serie de fraudes en los que participaron muchas instituciones financieras, como bancos comerciales y de inversión, calificadoras crediticias, aseguradoras, etc. Estos fraudes se ejecutaron a través de préstamos de alto riesgo, como las hipotecas de alto riesgo o subprime mortgage y los préstamos de alto riesgo de muy baja calidad o NINJA loans; y productos financieros con riesgo, como las garantías hipotecarias o mortgage-back securities, las permutas de incumplimiento crediticio o credit default swaps, y las obligaciones de deuda garantizada o collateralized debt obligations.

Para que sea claro, en los primeros años del 2000 algunos inversionistas estadounidenses y extranjeros buscaban inversiones de bajo riesgo y alto rendimiento, y apostaron por el mercado inmobiliario de EE.UU, pues creían que las ganancias de las tasas de interés de las hipotecas eran muy buenas.

Todo comenzó a complicarse cuando estos inversionistas se rehusaron a comprar hipotecas independientes, juntándolas e invirtiendo así en garantías hipotecarias o mortgage-back securities, las cuales fueron creadas por grandes instituciones financieras a partir de la transformación de activos fijos tangibles –como casas– en valores. En otras palabras, estas instituciones financieras compraron miles de hipotecas, las agruparon, y vendieron acciones de dicha agrupación a los inversionistas.

Al principio estas inversiones parecían seguras, pues los precios de las casas comenzaron a aumentar y, por ello, los prestamistas creyeron que si algunos prestatarios caían en impago las casas se podrían vender aún más caras, de tal manera que no se perdía el dinero. Además, las agencias de calificación crediticia aseguraron a los inversionistas que las garantías hipotecarias eran confiables, dándoles una calificación AAA, esto es, la mejor calificación.

Así, creció la demanda por las garantías hipotecarias y, en consecuencia, las instituciones financieras crearon aún más. No obstante, era necesario que aumentara el número de hipotecas, por lo que bajaron los estándares para otorgar créditos, es decir, se les comenzó a otorgar préstamos a personas con un mal historial crediticio, personas con bajos ingresos, personas sin trabajo, etc. A estas hipotecas se les conoce como hipotecas de alto riesgo o subprime mortgage. Eventualmente, dada la presión y desesperación por generar más hipotecas, algunas instituciones financieras pusieron en práctica préstamos predadores o préstamos de muy alto riesgo de muy baja calidad, conocidos como NINJA loans, los cuales consisten en ni siquiera verificar los ingresos del prestatario. Al principio estos préstamos se ajustaban a las capacidades del prestatario, pero rápidamente terminaban por superar su capacidad de pago.

Sin embargo, debido a que esta situación era reciente, la calificación de las inversiones no bajó y los inversionistas siguieron poniendo su dinero en ellas, pero el riesgo iba en aumento. Por ejemplo, se crearon las obligaciones de deuda garantizada o collateralized debt obligations, las cuales también recibieron calificaciones crediticias muy altas, aunque en realidad estaban hechas con base en préstamos de muy alto riesgo.

Entonces, en tanto los inversionistas ponían cada vez más dinero en el mercado hipotecario de EE.UU, se otorgaban más créditos para comprar casas y, en consecuencia, los precios de éstas aumentaban. Es decir, oferta y demanda, fue como un proceso inflacionario que simultáneamente causó que las garantías hipotecarias y las obligaciones de deuda garantizada parecieran mejores inversiones. En otras palabras, si el prestatario incurría en impago, no había problema, pues el banco todavía tenía la casa excesivamente cara para vender.

El resultado de esta situación fue que después de un tiempo muchos prestatarios cayeron en impago y la oferta de viviendas aumentó de nuevo, no obstante, la demanda disminuyó. Por ello, los precios de las casas se vinieron abajo y los prestatarios comenzaron a pagar más por su hipoteca, haciendo que aún más de ellos cayeran en impago. De esta manera los precios de las casas empezaron a colapsar.

Los inversionistas dejaron de invertir, valga la redundancia, en los productos financieros de riesgo y los prestamistas de las hipotecas que componían dichos productos se quedaron atrapados con los préstamos. Pero el problema era más complejo, pues dentro de toda esta situación se creó otro instrumento financiero conocido como permutas de incumplimiento crediticio o credit default swaps, los cuales se vendían como seguros contra el impago de las garantías hipotecarias. American International Group, una corporación multinacional de finanzas y seguros, vendió una cantidad exagerada de millones de dólares de estos seguros sin tener dinero para respaldaros si algo salía mal, pues nadie esperó que esto resultara en una crisis mundial.

Así, desde 2007 algunas instituciones financieras se declararon en bancarrota, una de las más importantes fue Lehman Brothers. Otras tuvieron que fusionarse o ser rescatadas por el gobierno. Asimismo, inversionistas internacionales sufrieron grandes e importantes pérdidas, muchísimas personas se quedaron sin trabajo y/o sin proyectos y otras tantas sin hogar.

Finalmente todo el sistema financiero estuvo a punto de derrumbarse y comenzó un periodo de recesión económica a nivel mundial.

Desde 2001 muchos economistas advirtieron a las autoridades financieras de EE.UU sobre el surgimiento de una burbuja en el mercado inmobiliario y las posibles consecuencias de ésta. No obstante, en 2002, el presidente de la Reserva Federal (Fed, por sus siglas en inglés) de aquella época, Alan Greenspan, desestimó las advertencias argumentando que el mercado inmobiliario no se parecía en nada al mercado bursátil –que en el año 2000 había sufrido el colapso de la burbuja “puntocom”–, pues en el mercado inmobiliario eran mayores los costos de transacción y había menos oportunidades para la especulación. Asimismo, aseveró en que no existía un mercado nacional para viviendas, sino un conjunto de mercados locales y, por lo tanto, si llegara a surgir una burbuja en uno de estos, no había razón para creer que se extendería a los demás mercados.

En 2003 Shiller y Case presentaron un análisis detallado sobre los factores psicológicos que estaban generando la burbuja en el mercado inmobiliario. Por ejemplo, las grandes expectativas sobre el incremento en los precios de las viviendas, el aumento de inversión en este mercado y un sentido de urgencia y oportunidad entre los compradores de casas. Así, alertaron sobre que estas señales eran clásicas de una burbuja especulativa.

En 2004 la preocupación acerca de la emergencia de una burbuja especulativa ya se había generalizado, sin embargo, las autoridades responsables continuaron negando su existencia. Por ejemplo, la Corporación Federal de Seguro de Depósitos (Federal Deposit Insurance Corporation) calmó el ambiente diciendo que desde la Gran Depresión no habían disminuido los precios de las viviendas a nivel nacional y, además, los avances en la estructura del financiamiento hipotecario hacían poco probable un escenario similar al de aquella época.

Del mismo modo, el Fondo Monetario Internacional (FMI) señaló que había movimientos sincronizados en los precios de las viviendas a nivel internacional, lo cual hizo creer a muchos que el mercado inmobiliario tenía más liquidez de lo que se asumía.

En 2005 Greenspan reiteró que no había problema. Aceptó que había aumentado un poco la inversión en el mercado inmobiliario, no obstante, no representaba una porción importante de éste. El mismo punto de vista lo compartía la Fed de Nueva York. Para este grupo, la preocupación sobre una burbuja especulativa era ridícula, pues el aumento en los precios de las viviendas se debía a los factores positivos que afectan dicho mercado, y no a las expectativas sobre el incremento en los precios.